Cominciamo il viaggio all'interno delle strutture logico-funzionali della conoscenza, ossia all'interno delle dinamiche che fanno evolvere i dati in informazioni; queste ultime in conoscenza, che poi, con il supporto della sperimentazione, si trasformain sapere, e in ultima istanza, in saggezza. Tutto ciò a prescindere dal linguaggio e dal glossario che caratterizza l’ambito (o dominio) disciplinare di interesse.

Siamo abituati già, dai primi anni di scuola, ad acquisire una conoscenza frazionata data dalla separazione delle varie discipline (italiano, matematica, scienze, ecc.), mentre ci troviamo a vivere poi una realtà dove si fa una inutile fatica a distinguere una disciplina dall’altra: “Le discipline, così come noi le conosciamo, sono state storicamente separate l’una dall’altra da confini convenzionali che non hanno alcun riscontro con l’unitarietà tipica dei processi di apprendimento. Ogni persona, a scuola come nella vita, impara infatti attingendo liberamente dalla sua esperienza, dalle conoscenze o dalle discipline, elaborandole con un’attività continua e autonoma. Oggi, inoltre, le stesse fondamenta delle discipline sono caratterizzate da un’intrinseca complessità e da vaste aree di connessione che rendono improponibili rigide separazioni” (dal testo delle Indicazioni Nazionali del MIUR).

Crescendo e facendo esperienze di vita e di lavoro, acquisiamo una visione più integrata e interdisciplinare delle cose e dei fatti, maturiamo maggiore perizia nelle attività lavorative e acquisiamo consapevolezza che il nostro sapere (frutto di conoscenza e sperimentazione), si trasforma in un grosso vantaggio competitivo nell’attività lavorativa e nella nostra vita.

L’interdisciplinarietà è il risultato di un percorso di apprendimento in grado di instaurare un rapporto di interazione e di analogia tra discipline differenti, ma anche tra settori della stessa disciplina.

L’apprendimento interdisciplinare è il processo cognitivo in grado di decodificare ed integrare diversi “punti di vista disciplinari” su un medesimo tema e di trarne una sintesi concettuale condivisa, in grado di valorizzare ciò che “unisce” e di minimizzare ciò che “divide”. Non si tratta quindi, di acquisire le competenze da “tuttologo”, ma di utilizzare un percorso di apprendimento basato sull’utilizzo, per analogia logico-funzionale, di modelli di conoscenza come supporto alla condivisione ed integrazione di concetti e valori. L’apprendimento inizia comunque, con l’ascolto.

L’apprendimento interdisciplinareè motivato dalla curiosità di conoscere la “realtà trasversale” delle cose, con la ricerca dei nessi comuni e dei principi disciplinari che spiegano i diversi fenomeni, in rapporto alla sperimentazione e all’esperienza personale: in altri termini, apprendimento non per verticalizzazioni specialistiche, ma per trasversalità concettuali o modelli di conoscenza e di esperienza.

L’apprendimento #interdisciplinareconsidera i fatti e l’esperienza, ricerca le giustificazioni non solo nelle discipline tecnico-scientifiche, ma anche nell’ambito delle conoscenze antropologiche e storico-sociali; è “mentalmente aperto” e “concettualmente evolutivo”. Non ci sono preconcetti o dogmi, ma ogni ragionamento o modello di conoscenza è in evoluzione, pur in un contesto di esperienze di riferimento. L’apprendimento interdisciplinare è sicuramente favorito dal coinvolgimento personale e, a questo proposito, si possono indicare tre risorse fondamentali target atte a favorire un “effetto di lunga durata”:

- Motivazione: derivante dall’interesse al raggiungimento di obiettivi chiari (la motivazione è il “combustibile” che porta a perseverare per il raggiungimento degli obiettivi).

- Passione: un intenso coinvolgimento e un forte desiderio per una determinata attività o interesse (rappresenta la “potenza motore” della conoscenza).

- Entusiasmo: incontenibile spinta ad agire ed a operare dando tutto sé stessi (è il “collante” che trascina contagiosamente).

Per gli scopi tecnico-operativi di particolare interesse, si farà qui di seguito riferimento alla #Conoscenza(“C” maiuscola nel senso di nome proprio del patrimonio economico intangibile che rappresenta) come “la facoltà umana risultante dall’interpretazione deidatie delleinformazioni finalizzata all’azione”, ovvero il risultato di un processo di inferenza e di sintesi (ragionamento), a partire da dati verso la “saggezza”.

Paradigma della “Catena della Conoscenza” (DIKW): la maggior parte delle definizioni della Conoscenza sono correlate alla cognizione dei fatti, della verità o dei principi, ma la definizione che forse meglio esprime la sua funzionalità tecnico-operativa è data dall’acronimo “DIKW” (Data, Info, Knowledge, Wisdom), intesa come “Catena della Conoscenza”, in grado di rappresentare le relazioni funzionali tra dati, informazioni, conoscenza e saggezza. Nel paradigma della “Catena della Conoscenza” (Knowledge Chain) si distinguono i Dati dalle Informazioni (Info) e queste ultime dalla Conoscenza, fino ad arrivare al concetto di Saggezza.

Catena della Conoscenza (Knowledge Chain –DIKW)

Dal dato alla infovi è un salto qualitativo in termini di “inferenza” o di relazione rispetto a possibili “azioni” conseguenti: una raccolta di dati (rappresentati da simboli alfanumerici, parole, immagini, ecc.) può produrre informazioni solo se gli stessi contribuiscono a caratterizzare dei fatti, delle verità o dei principi.

I dati sono definibili come entità statiche, “fotografie” di fatti e sono quindi espliciti, in genere sono espressi in forma alfanumerica, prodotti da fonti (database, sensori, ecc.) che ne condizionano poi la loro “qualità”.

Le informazioni sono invece entità dinamiche ed evolutive, caratterizzate da un proprio ciclo di vita: nascono in forma esplicita o latente, sono correlate ad uno o più processi (mentali, personali, ambientali, produttivi ecc.) ed esercitano su tali processi una propria influenza (o “peso”).

Ci troviamo quindi, di fronte ad un paradosso per cui i “dati” e le “informazioni” posso avere formalmente una medesima espressione numerica, ma nel secondo caso il valore numerico fornisce la possibilità di sviluppare un ragionamento, e quindi, di generare Conoscenza. Infine, è possibile parlare di informazioni quando queste ultime esprimono la dinamica di un cambiamento circa un evento o un fatto.

Il risultato di un processo di inferenza e di sintesi (ragionamento) sulle info produce quindi Conoscenza, mentre è necessario un ulteriore salto di qualità per definire il passaggio da Conoscenza a Saggezza (v. anche buonsenso): laSaggezza può essere definita come il più alto livello di astrazione della Conoscenza; è una caratteristica mentale personale legata alla capacità di giudizio e di buonsenso, in grado di aumentare l’efficacia e il valore dei risultati dei ragionamenti e della presa di decisione.

Infine, il concetto di Knowledge Chain DIKW può essere meglio rappresentato considerando che la Conoscenza, acquisita come risultato di un’inferenza tra informazioni di base (un ragionamento), non è ancora operativa senza un processo di “sintesi” e una opportuna strategia di “comunicazione”.

Catena estesa della Conoscenza verso l’Approccio Interdisciplinare

In questo caso, ci si trova di fronte ad una più raffinata Knowledge Chain che considera l’importanza dell’inserimento della “Comunicazione Interdisciplinare della Conoscenza”, in tutte le sue modalità (verbale, scritta e non verbale).

L’Unità di Conoscenza (“Basic-Info“):è stata già evidenziata la differenza tra dati e info; ora è necessario introdurre il concetto di “peso” o di “influenza“ che un’informazione assume nella “Knowledge Chain”, secondo un possibile contesto di ragionamento. In genere, una possibile Knowledge Chain ha a che fare con uno scenario di dati e info, ma è ovvio che ogni informazione può avere un peso diverso e può essere parzialmente o totalmente giusta o sbagliata in un contesto di ragionamento, a seconda del target finale.

Le “informazioni” con un alto tasso di certezza potrebbero avere un peso ridotto rispetto al target di ragionamento finale e viceversa. Ciò significa che le “informazioni” devono essere gestite in un contesto non deterministico di valutazione e calcolo. In questo modo quindi, si mette in evidenza un’altra differenza tra “dati” e “info”:

- calcolo con “dati” significa applicazione di regole matematiche deterministiche classiche (addizione, sottrazione, ecc.);

- calcolo con “info” significa l’applicazione di nuove regole di calcolo non deterministiche, perché “info” può essere parzialmente/ totalmente certa o completa (quindi, con peso diverso – v. Fuzzy Logic).

Qual è la più piccola unità di base della Conoscenza? – È quella rappresentata da un singolo dato in grado però di influenzare un target di ragionamento. È possibile infatti, affermare che un’unità informativa di basedeve esprimere una relazione quali-quantitativa tra la tipologia del dato e un possibile target di ragionamento.

Inoltre, una Unità di Conoscenza o “Basic-Info” deve essere costituita dai seguenti componenti e proprietà fondamentali:

- Input: Dato (con il proprio valore reale)

- Output: Peso o Influenza (valore normalizzato tra 0 e 1)

- Curva di Conoscenza (trend es. crescente o decrescente)

- Regole di inferenza (nell’intervallo di valori di validità dell’input).

In sintesi una unità di Conoscenza o Basic-Info è esprimibile come:

Suddivisione sistemica in Basic-Info di un dominio di Conoscenza

Rappresentazione delle componenti di una Basic-Info

Grado di “certezza” e propagazione delle Basic-Info: un’altra questione importante è quella di mettere in evidenza il livello di certezzao diverità inerente i dati e le informazioni. Per maggiore semplicità di comprensione, si può considerare il “tasso di certezza“, come il “peso” che acquisisce il valore di un dato in riferimento ad un prefissato target di ragionamento.

La propagazione dei “pesi” contenuti nelle diverse informazioni di input (A, B, C) di un ragionamento deduttivo si compone come una “intersezione insiemistica” dove i sottoinsiemi di intersezione che si propagano, contengono “maggiore certezza” rispetto al target/azione finale e riducono man mano l’errore (incertezza) finale del ragionamento.

Rappresentazione di un ragionamento con 3 informazioni input (A, B, C) rispetto ad un Target (decisione finale)

Modelli Cognitivi di Basic-Info e Reti Neurali – la riflessione sulle Basic-Info con il loro “peso” dinamico, ovvero con la propria singola influenza in un ragionamento target, si può estendere ad un numero anche molto grande di Dati/Basic-Info concorrenti rispetto a diversi possibili target di ragionamento.

Questo caso può essere rappresentato da una Matrice di Correlazione Causa/ Influenza/ Target, ovvero da una Rete Cognitiva di Basic-Info dove le “righe” rappresentano i Dati acquisiti da una o più sorgenti anche eterogenee tra loro, mentre le “colonne” sono i Target di Ragionamento possibili in relazione ad un determinato ambito di conoscenza (diagnosi, presa di decisione, classificazione, ecc.)

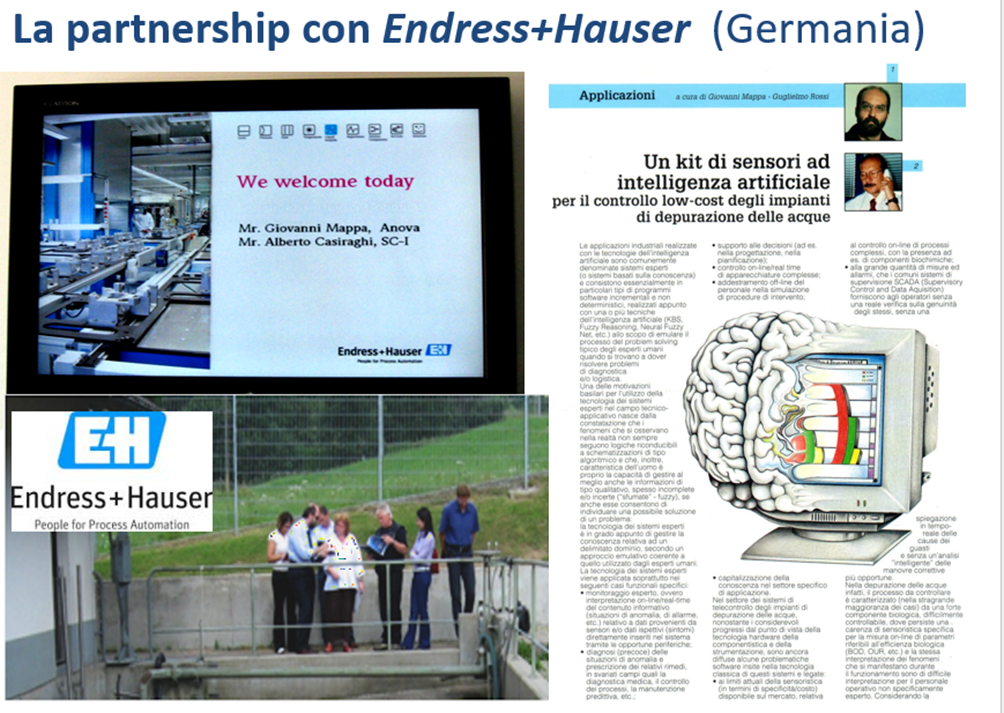

Software Toolbox to develop “Knowledge Curves” (“K-Neurexp” ANOVA – http://www.anovastudi.com)

Se consideriamo un interosistema complesso di Conoscenza(Complex Knowledge’s System Ω), quest’ultimo può essere sempre suddiviso in sottodomini (Di) più piccoli e più semplici, fino a poter essere descritte da Matrici di Correlazione (Correlation Matrix System):

Scomposizione di un dominio complesso di Conoscenza i sotto domini più semplici

Questo approccio consente di sviluppare Reti Cognitive che possono essere utilizzate nel dominio della conoscenza sia in forma numerica che testuale, nonchésviluppare Sistemi basati sulla Conoscenza (Knowledge Based Systems) e in tempo reale (Real Time) per processi industriali, ambientali, “presa di decisione”, diagnostici, ecc. Ad esempio, nel caso che dovessimo far prendere una decisione, per nostro conto, ad una rete cognitiva informatica (v. Intelligenza Artificiale) su “cosa fare?” in un certo momento della giornata, tra:

- andare in palestra (Gym);

- al bar (Pub);

- a passeggiare con gli amici (Walking);

- andare al cinema (Cinema);

la rete cognitiva andrebbe a correlare tra loro ad es. dati/info qualitativi come il nostro bioritmo (Biorhythmic), le condizioni meteo al momento (Weather), la nostra età (Age), il nostro stato di “libertà” da impegni importanti (Freedom), secondo una “rete di ragionamento” (v. fig. seg.) ispirata alle reti neurali biologiche (del cervello): in questo caso (molto semplice), la corrispondente rete cognitiva assumerebbe il seguente schema funzionale di ragionamento (con tre livelli di sintesi):

In generale, le reti cognitive possono assumere forme più complesse, come la composizione e l’integrazione dello schema sopra mostrato, con più di due o tre livelli di nodo, più di quattro nodi per livello e più di un tipo di curve di conoscenza per ogni Basic-Info.

Analogia delle Reti Cognitive di Basic-Info con le Reti Neurali Artificiali (ANN) – Nel campo dell’apprendimento automatico (Machine Learning), una rete neurale artificiale (Artificial Neural Network, ANN) è un modello computazionale composto di “neuroni” artificiali, che si ispira vagamente alla semplificazione di una rete neurale biologica. Quest’ultima è costituita da interconnessioni tra nodi (sinapsi) ed a “pesi” numerici associati a ciascuna interconnessione. Ognuna di queste interconnessioni, come le sinapsi in un cervello biologico, può trasmettere un segnale mediante una funzione di attivazione ad altri neuroni.

Un neurone artificiale che riceve un segnale poi l’elabora e può segnalare neuroni ad esso collegati (figura (a)). In ogni neurale rete, esiste un’unica funzione di attivazione (una sigmoide, una scala funzione, ecc.). Questa funzione rappresenta un’informazione elementare che elabora i pesi dei nodi di input e restituisce (in genere) in maniera deterministica un peso risultante in output. .

Il mondo reale invece, non è deterministico; pertanto è necessario trovare un modo non deterministico per risolvere il problema reale. La Rete Cognitiva di Basic-Info (figura (b)) utilizza un approccio non deterministico: presenta una struttura reticolare, come in una classica neurale rete neurale artificiale ANN, ma ogni singolo nodo contiene una matrice [m*n] di funzioni di attivazione (b), piuttosto che una singola funzione (a). Ogni nodo elementare rappresenta una Base di Conoscenza (Knowledge Base). Le interconnessioni tra questi neuroni consentono poi di fondere diversi processi cognitivi. Nelle reti cognitive di Basic-Info, ogni nodo rappresenta quindi, un dominio omogeneo di Conoscenza, avente come punto di riferimento ciascuno dei “nodi di conoscenza“: nodi indipendenti, nei quali si fondono i dati primari. Questi dati vengono trasformati, prima, in informazioni, poi in una Knowledge Base omogenea, specifica per la fonte area dei dati.

Quindi, partendo da concetti elementari, le interconnessioni creano, dinamicamente, nuovi livelli più evoluti di sintesi della Conoscenza. Il livello finale produrrà le regole e le azioni del “sistema esperto”. Ad ogni livello, la Conoscenza è “sintetizzata”, mentre al livello finale, si arriva ad osservare una riduzione dei nodi cognitivi finalizzata alla elaborazione degli output decisionali.

Cognitive Network “K-Neurexp” application (G. Mappa, 1997)

Una rete cognitiva basata su Basic-Info, offre i seguenti vantaggi rispetto alle ANN:

- non è composto da un’unica funzione di attivazione, ma da una matrice di funzioni di attivazione;

- è un sistema “chiaro” e non una “scatola nera”, poiché si conosce il dominio dell’applicazione e la Conoscenza viene introdotta nel nodo della rete;

- è molto efficiente, poiché esistono diverse funzioni di attivazione;

- ogni neurone esperto ha una correlazione con un sottodominio omogeneo;

- ogni nodo permette di trasformare un input in un risultato definitivo o parziale, chiamato meta-informazione;

- permette di rappresentare il dominio della Conoscenza eterogeneo ed esteso;

- opera con diversi set di input, sia qualitativi che quantitativi;

- ad ogni passo, permette di ottenere un livello maggiore di sintesi della Conoscenza.

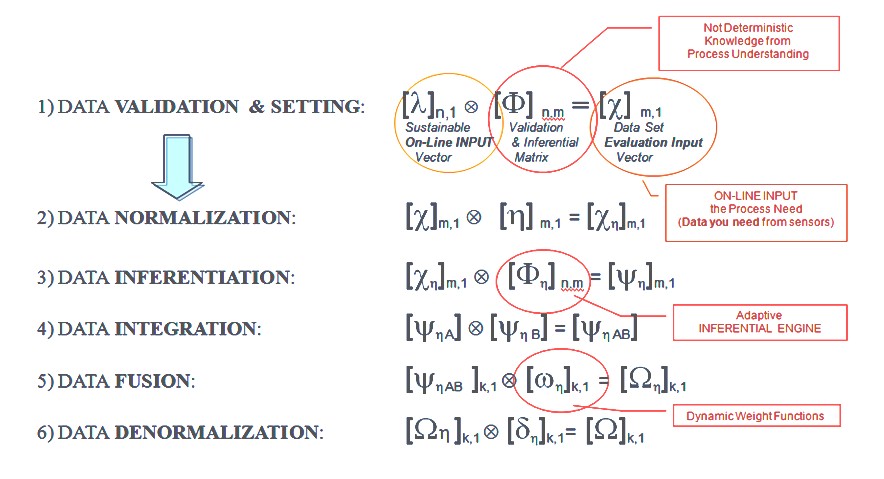

Processo tipico di “modellazione” della Conoscenza con le Basic-Info – In generale, un processo tipico di “modellazione” della Conoscenza, soprattutto nella realizzazione di sistemi on-line di controllo intelligente, segue alcuni passi fondamentali come la formalizzazione e validazione dei dati acquisiti da sorgenti eterogenee esterne, la normalizzazione rispetto ai range di operatività, l’inferenziazione di cross-matching (inferentation-integration-data fusion), la de-normalizzazione dei risultati target ottenuti.

Dal punto di vista concettuale, questo processo di “modellazione della conoscenza” può essere raffigurabile anche come una rete neurale costituita da “nodi” (neuroni) come unità base di elaborazione delle informazioni (Basic-Info), e “collegamenti” (sinapsi) come adduttori di inferenza caratterizzata da un grado di certezza (“peso” dinamico non probabilistico).

Per prima cosa vedono entrare due persone in casa. Il tempo passa. Dopo un po’ notano che escono tre persone.

Per prima cosa vedono entrare due persone in casa. Il tempo passa. Dopo un po’ notano che escono tre persone.